เมื่อ Google ซื้อ DeepMind ในปี 2014 มันลงทุนในงานวิจัยปัญญาประดิษฐ์ (AI) ที่ทันสมัยบริษัท ที่กำลังมองหา“ รวมการเรียนรู้และระบบประสาทวิทยาศาสตร์เพื่อสร้างอัลกอริทึมการเรียนรู้ที่มีประสิทธิภาพทั่วไป”

รายละเอียดเกี่ยวกับการทำงานของ Google และ DeepMind ใน AI นั้นไม่เพียงพอจนถึงสัปดาห์นี้เมื่อวารสารวิทยาศาสตร์ธรรมชาติเปิดเผยว่า บริษัท วิจัย AI กำลังทำอะไรอยู่ในกระดาษชื่อ“การควบคุมระดับมนุษย์ผ่านการเรียนรู้การเสริมแรงอย่างลึกซึ้ง” กระดาษแสดงให้เห็นว่า AI DeepMind กำลังยุ่งอยู่กับการเรียนรู้เกี่ยวกับข้อมูลวิดีโอเกม Atari 2600- บทเรียนที่ยิ่งใหญ่จนถึงตอนนี้? ปัญญาประดิษฐ์ของ DeepMind อาจทำได้ดีผู้บุกรุกอวกาศแต่เรายังคงห่างไกลจากนักเล่นเกมปัญญาประดิษฐ์

Google DeepMind AI เล่นผู้บุกรุกอวกาศ

ที่ธรรมชาติกระดาษและผู้เขียนร่วม 19 คนรวมถึงผู้ก่อตั้ง DeepMinddemis hassabisและขาเชน-แสดงให้เห็นถึงความแข็งแกร่งของการเรียนรู้การเสริมแรงในการพัฒนาโปรแกรมที่สามารถสอนตัวเองเพื่อบรรลุวัตถุประสงค์ของมนุษย์ ในกรณีนี้ปัญญาประดิษฐ์ DeepMind ซึ่งอธิบายไว้ในกระดาษว่าเป็น“ เครือข่าย Qu-network” วิ่งหลายครั้งโดยการสุ่มความสำเร็จในเกมโดยพื้นฐานแล้ว“ พัฒนา” ทักษะที่ดีขึ้นและดีขึ้นผ่านการทำซ้ำ

AI ที่ลึกลงไปความสำเร็จที่ยิ่งใหญ่ในเกมเช่นผู้บุกรุกอวกาศ-การฝ่าวงล้อม-ดาร์บี้ตกปลา-ทางด่วน-StarGunner-นักปีนเขาบ้า-ถ้า FU Master, และถังหุ่นยนต์ในเกมอาตาริหลายเกม DeepMind AI ไกลเกินกว่าผู้เล่นที่ดีที่สุด ถึงกระนั้น AI ก็พิสูจน์ให้เห็นว่าไม่เหมาะสมในวิดีโอเกมอื่น ๆ รวมถึงMs. Pac-Man-ตาส่วนตัวและการแก้แค้นของ Montezuma-

DeepMind AI ล้มเหลวในวิดีโอเกมบางเกมด้วยเหตุผลหลายประการทบทวนเทคโนโลยี MITเน้นย้ำถึงการที่ AI ไม่สามารถ“ วางแผนเท่าที่ไม่กี่วินาทีข้างหน้า” DeepMind AI มีความไม่สามารถในการค้นหาและใช้หลักการใหม่กับสถานการณ์ใหม่ ซึ่งแตกต่างจากนักเล่นเกมมนุษย์ที่สามารถใช้สิ่งอำนวยความสะดวกในเกมหนึ่งและพอร์ตทักษะเหล่านั้นไปยังอีกเกมหนึ่ง AI ปัจจุบันไม่มีความสามารถในการสร้างเดียวกันหลักการ Meta-Cognition- คิดเกี่ยวกับการคิดและปรับ- นั่นทำให้มนุษย์คิดว่ายืดหยุ่น

Shane Legg ผู้ร่วมก่อตั้ง Google Deepmind เกี่ยวกับภัยคุกคาม AI

ความล้มเหลวในการเล่นเกมของ Google AI เน้นช่องว่างอันยิ่งใหญ่ระหว่างคำสัญญาของ AI และความเป็นจริงในวันนี้ ในขณะที่การรวมตัวกันของเทคโนโลยีปัญญาประดิษฐ์ในปัจจุบันที่มีสติปัญญาเหมือนมนุษย์ส่วนใหญ่เป็นความผิดของสื่อที่บิดเบือนความจริงสถานะของศิลปะในการวิจัยปัญญาประดิษฐ์ แต่ก็เป็นเรื่องง่ายที่จะจินตนาการว่า บริษัท AI เช่น DeepMind ได้รับประโยชน์จากเรื่องราวที่สร้างความสับสนและอัลกอริธึมที่ซับซ้อนและทรงพลังLoenid กับบลูมเบิร์กมีมากขึ้นเกี่ยวกับวิธีที่ บริษัท เทคโนโลยีจะได้รับประโยชน์จาก“ AI hype ที่เลวร้ายที่สุด”-

คำเตือนของ AI มากเกินไป

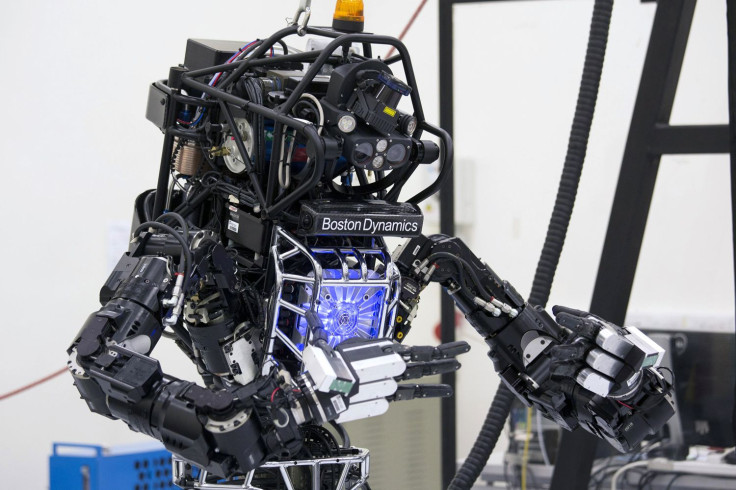

แม้จะมีคำเตือนจากพาดหัวจากบุคคลสาธารณะเช่น Elon Musk, Bill Gates และ Stephen Hawking แต่การสัมภาษณ์ IdigitalTimes ด้วยหน่วยงานวิจัยขั้นสูงของหน่วยงานวิจัย (DARPA) หุ่นยนต์ดร. กิลแพรตต์เผยให้เห็นถึงความจำเป็นในการระมัดระวังในการประเมินปัญญาประดิษฐ์ของเราโดยเฉพาะอย่างยิ่งในสาขาหุ่นยนต์ที่มักจะบิดเบือนไปสู่สถานการณ์สันทรายในจินตนาการที่เป็นที่นิยม

“ [มี] การกดจำนวนมากโดยผู้ทรงคุณวุฒิหลายประเภทในหลาย ๆ สาขาที่บอกว่า 'เฮ้พวกเราทุกคนต้องระวังเพราะเราอาจจบลงด้วยการสร้างระบบที่ลงโทษเราในอนาคต” แพรตต์กล่าว “ ฉันเคารพความคิดเหล่านั้นมากมาย แต่ในขณะเดียวกันก็มีช่องว่างอันยิ่งใหญ่ระหว่างความสามารถที่เรามีอยู่ในตอนนี้และความกังวลที่กำลังแสดงออกมาดังนั้นความกังวลนั้นถูกต้องตามกฎหมายในอนาคต แต่ฉันคิดว่ามันสำคัญมาก

ในขณะที่แพรตต์กำลังพูดถึงภัยคุกคาม AI โดยทั่วไปการสาธิตวิดีโอเกม DeepMindเป็นหลักฐานที่ดีที่สุดของเรา แต่คำเตือนของมัสค์ว่า "ความเสี่ยงของสิ่งที่เป็นอันตรายอย่างจริงจังเกิดขึ้นในกรอบเวลาห้าปี ... มากที่สุด 10 ปี" อาจจะล้นเกิน มัสค์เน้นย้ำความกลัวของเขาไม่ได้ถูก จำกัด ไว้กับ AI ที่“ แคบ” เป็นตัวอย่างโดยระบบเช่น Siri ซึ่งขึ้นอยู่กับอัลกอริทึมการเรียงลำดับที่ซับซ้อนและชุดข้อมูลอันยิ่งใหญ่เพื่อให้ภาพลวงตาอย่างไรก็ตามการมีปฏิสัมพันธ์กับสติปัญญาเหมือนมนุษย์ ค่อนข้างมัสค์ลงทุนใน DeepMindไม่ใช่เพื่อการกลับมา แต่“ เพียงแค่จับตาดูสิ่งที่เกิดขึ้นกับปัญญาประดิษฐ์”

ตามมัสค์ใครเป็นผู้แจ้งเตือนในความคิดเห็นของบทสัมภาษณ์กับ AI Skeptic Jaron Lanier“ ถ้าคุณไม่ได้สัมผัสกับกลุ่มอย่าง DeepMind โดยตรงคุณก็ไม่รู้ว่าเร็วแค่ไหน ... มันเติบโตขึ้นอย่างใกล้ชิดกับเลขชี้กำลัง”

แพรตต์แม้ว่าจะไม่ได้กล่าวถึงคำเตือนของมัสค์โดยเฉพาะดูเหมือนว่าจะไม่เห็นด้วย มีเส้นแบ่งระหว่างระบบการรับรู้ที่ซับซ้อนมากขึ้นและระบบการเรียนรู้และจิตสำนึกที่เหมือนมนุษย์ซึ่งเราจินตนาการถึงการวิจัย AI ที่เป็นผู้นำเขาอธิบาย

“ สิ่งที่เราเริ่มเรียนรู้ที่จะทำคือการสร้างระบบการรับรู้ในหุ่นยนต์ที่สามารถเริ่มจดจำสิ่งต่าง ๆ ที่ผู้คนทำ” แพรตต์กล่าว “ ตอนนี้เครื่องจักรเหล่านี้สามารถจดจำสิ่งต่าง ๆ และรู้ถึงความแตกต่างระหว่างขวดโซดาและแว่นตาคู่หนึ่งเมื่อพวกเขามองออกไปทั่วโลก แต่พวกเขาไม่รู้ว่าจุดประสงค์ของขวดโซดาคืออะไรพวกเขาไม่รู้จุดประสงค์ของแว่นตาพวกเขาไม่รู้ว่าคุณสามารถทำอะไรกับไอเท็มเหล่านี้ได้”

“ การเรียนรู้เสริมแรง” ของอาตาริที่ใช้กับ DeepMind AI ของ Google นั้นเป็นความสำเร็จที่น่าประทับใจและการขยายขีดความสามารถของเราในการสร้างเครื่องจักรที่สามารถแก้ปัญหาได้ตามพารามิเตอร์หลวมเพื่อความสำเร็จ อย่างไรก็ตามยังไม่ได้เข้าใกล้ "ปีศาจ" ที่ไม่สามารถควบคุมได้โดย Musk หรือ "คอมพิวเตอร์ที่คิดเหมือนคน" ที่สัญญาไว้AI Start-Up Vicarious 'สกอตต์ฟีนิกซ์ผู้ร่วมก่อตั้งบางทีประตูและวิสัยทัศน์ที่เลวร้ายของเขาจากภัยคุกคาม AI ใน“ ไม่กี่ทศวรรษ” เป็นเกณฑ์มาตรฐานที่ดีกว่า

คำสัญญาของ AI

การทำความเข้าใจทั้งสัญญาและข้อ จำกัด ของการวิจัยของ Google DeepMind AI นั้นเป็นส่วนสำคัญในการสร้างความสัมพันธ์ในอนาคตกับเครื่องจักรของเรา พาดหัวข่าวจำนวนมากเกินไปถูกนำมาใช้กับภัยคุกคาม AI ในจินตนาการที่สามารถปิดบังการพิจารณาทางสังคมเกี่ยวกับการประยุกต์ใช้จริยธรรมในการคำนวณพลังไปยังสาขาของมนุษย์ เช่นคนขี้เกียจกล่าวว่า“ ถ้า AI เป็นของจริงมันอาจจะเป็นภัยคุกคามน้อยกว่าเรามากกว่าที่มันเป็นของปลอมฉันหมายถึงอะไรโดย AI ที่เป็นของปลอม?

แพรตต์นั้นใช้งานได้จริงและเน้นความโปร่งใส

“ ฉันคิดว่านักวิทยาศาสตร์และวิศวกรเป็นหนี้สาธารณะและผู้คนที่คิดเกี่ยวกับจริยธรรมคำอธิบายที่ซื่อสัตย์อย่างมากเกี่ยวกับสถานะของศิลปะ” เขากล่าว